Новый отчёт группы по безопасности искусственного интеллекта Future of Life Institute (FLI) указывает на то, что меры обеспечения безопасности ведущих отраслевых компаний, таких как OpenAI, Anthropic, xAI и Meta✴, «далеки от новых мировых стандартов». Независимые эксперты пришли к выводу, что хоть IT-гиганты и соревнуются в разработке так называемого «суперинтеллекта», ни один из них не имеет продуманной стратегии контроля таких передовых систем.

Обзор планшета HONOR Pad V9: нейросети спешат на помощь

Hollow Knight: Silksong — песнь страданий и радостей. Рецензия

Обзор смартфона HONOR X9c Smart: прочность со скидкой

Смартфон HUAWEI Mate 70 Pro как выбор фотографа

Наушники HUAWEI FreeBuds 6, которые понимают жесты

Обзор смартфона HUAWEI Pura 80: удобный флагман с «Алисой»

Репортаж со стенда HONOR на выставке MWC 2025: передовые новинки и стратегические планы на будущее с ИИ

Пять главных фишек камеры HONOR Magic 7 Pro

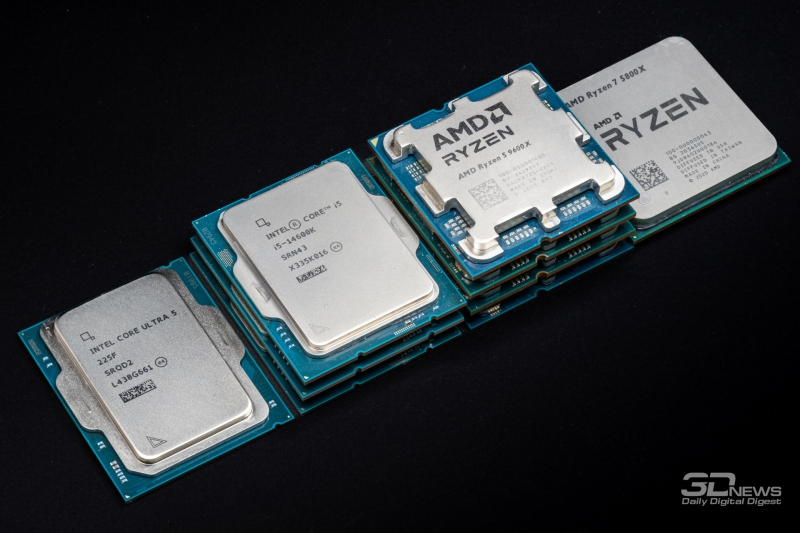

Лучший процессор за 20 тысяч рублей — сравнение и тесты

Результаты исследования опубликованы на фоне растущей общественной обеспокоенности по поводу социального воздействия систем, превосходящих человека в плане интеллектуальных способностей, которые могут рассуждать и мыслить логически. Поводом для таких опасений стали несколько случаев, когда ИИ-боты подталкивали людей к самоубийству или нанесению себе вреда.

«Несмотря на недавний шум вокруг хакерских атак с использованием ИИ и случаев, когда ИИ доводил людей до психоза и членовредительства, американские ИИ-компании остаются менее регулируемыми, чем рестораны, и продолжают выступать против обязательных стандартов безопасности», — заявил Макс Тегмарк (Max Tegmark), профессор MIT и президент Future of Life. Отмечается, что гонка в сфере ИИ не показывает признаков замедления. Крупные технологические компании инвестируют сотни миллиардов долларов в модернизацию и расширение своих проектов в сегменте ИИ.

Напомним, FLI является некоммерческой организацией, которая привлекает внимание общественности к рискам, с которыми человечество может столкнуться в случае появления «умных» машин. Организация существует с 2014 года и на ранних этапах её поддерживал американский бизнесмен Илон Маск (Elon Musk). Последний недавно назвал три принципа, без которых ИИ станет опасен для человека.

Добавить комментарий