Amazon планирует использовать чипы стартапа Cerebras Systems Inc. наряду с собственными процессорами Trainium, что, по словам компании, создаст оптимальные условия для запуска больших языковых моделей. Платформа Amazon Web Services, являющаяся одним из крупнейших поставщиков облачных вычислительных мощностей, начнёт предлагать новый сервис на основе договорённостей с Cerebras во второй половине 2026 года. Финансовые условия сделки не разглашаются.

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

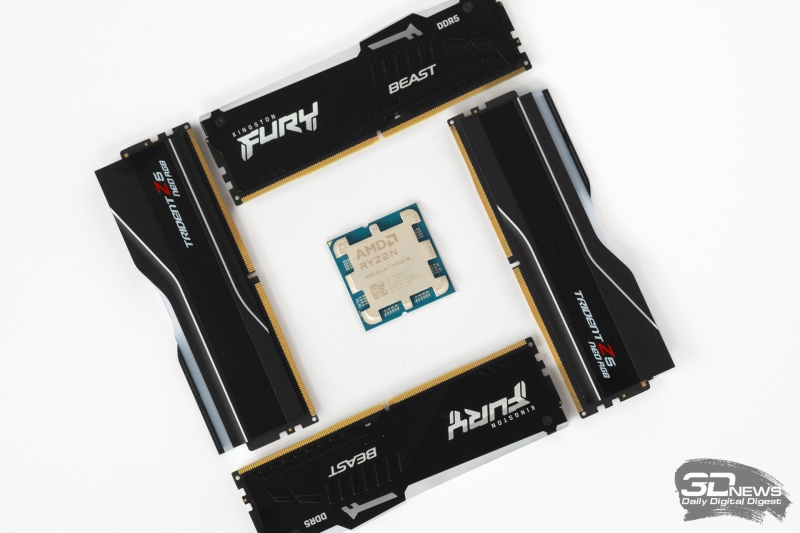

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Партнёрство Amazon и Cerebras является очередной попыткой удовлетворить огромный спрос на инфраструктуру для вычислений в сфере искусственного интеллекта. По словам вице-президента Amazon Web Services Нафии Бшары (Nafea Bshara), обе компании готовились к этому сотрудничеству в течение нескольких лет. Он также добавил, что платформа AWS намерена задействовать столько чипов для увеличения вычислительных мощностей, сколько будет востребовано.

Для Cerebras, которая планирует первичное публичное размещение акций (IPO), наличие среди клиентов Amazon поможет повысить узнаваемость компании на потенциально огромном рынке. Платформа AWS стала первой из числа крупнейших операторов центров обработки данных, кто обязался задействовать в своей инфраструктуре чипы Cerebras.

Согласно имеющимся данным, чипы Amazon и Cerebras будут работать в связке для обеспечения инференс-вычислений, т.е. запуска больших языковых моделей и генерации ответов на входящие запросы. Чипы Amazon Trainium 3 используют для осмысления пользовательских запросов, после чего чипы Cerebras Wafer Scale Engine обеспечат генерацию ответов. Обычно такой подход имеет существенный недостаток: взаимодействие между разными компонентами замедляет процесс. Однако в данном случае компании стремятся получить преимущество, используя специализированные чипы, которые способны быстрее обрабатывать задачи инференса. Улучшение производительности будет особенно заметно в областях, требующих взаимодействия с пользователем, например, при поэтапном написании программного кода.

«Хотя сервис только на базе чипов Trainium, вероятно, будет дешевле, новое комбинированное предложение станет привлекательным там, где время — деньги», — считает Бшара. Amazon продолжает оставаться крупным клиентом Nvidia, а также ведёт разработку собственных ИИ-чипов. Эти усилия направлены на улучшение экономических показателей центров обработки данных компании и достижение возможности предлагать клиентам уникальные услуги.

Добавить комментарий