Учёные Apple разработали технологию RubiCap — способ обучения моделей искусственного интеллекта описывать изображения более подробно и эффективно, чем это делают модели более крупного размера.

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

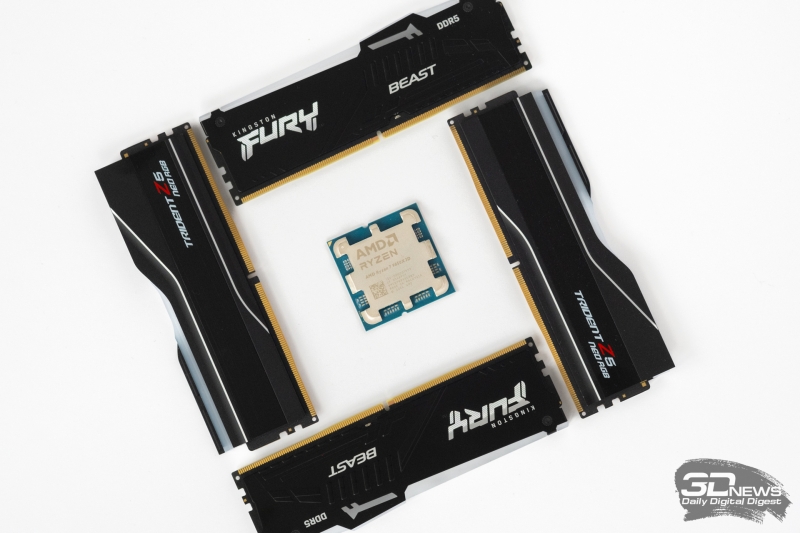

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

При подготовке подробного описания изображения ИИ-модели требуется идентифицировать множество объектов и областей в кадре, чтобы далее собственно описать их с высокой степенью детализации. Это помогает глубже понять композицию, чем при общем её описании. На практике такой навык может пригодиться для обучения производных ИИ-моделей, для создания генераторов картинок по текстовому описанию и для разработки специальных возможностей. Создание систем подробного описания картинок оказывается чрезмерно дорогим и ресурсоёмким как на этапе первичного обучения, так и в дальнейшем при обучении с подкреплением.

Для решения этих проблем инженеры Apple случайным образом выбрали 50 000 изображений из обучающих наборов PixMoCap и DenseFusion-4V-100K. Для каждой из этих картинок описания генерировали существующие модели с функциями компьютерного зрения, в том числе Google Gemini 2.5 Pro, OpenAI GPT-5, Alibaba Qwen2.5-VL-72B-Instruct, Google Gemma-3-27B-IT и Alibaba Qwen3-VL-30B-A3B-Instruct; собственные описания изображений создавали и текущие обучаемые модели Apple. Далее выступающая экспертом Gemini 2.5 Pro повторно анализировала изображения с вариантами подписей и результатами работы обучаемой модели; определяла, в чём участвующие в эксперименте системы совпадали, а какие детали упускали или искажали; и составляла чёткие критерии для оценки описаний. Выступающая в роли судьи Qwen2.5-7B-Instruct оценивала описания по каждому из предложенных критериев и формировала сигнал вознаграждения для обучаемой модели.

В результате обучаемая модель получала точную и качественную обратную связь о том, что надлежит исправить — и начинали генерироваться более точные описания без опоры на единственный «правильный» ответ. В итоге инженеры Apple обучили три собственные модели ИИ: RubiCap-2B, RubiCap-3B и RubiCap-7B с 2, 3 и 7 млрд параметров соответственно. В задачах на описание изображений они показали более качественные ответы, чем созданные другими разработчиками аналоги с 32 млрд и даже 72 млрд параметров. Примечательно, что RubiCap-3B в некоторых случаях демонстрировала более качественные результаты, чем RubiCap-7B — это подтверждает, что размер модели не всегда определяет её работу.

Добавить комментарий