Microsoft советует пользователям не полагаться на Copilot в случае важных рекомендаций, отметив, что ИИ-помощник предназначен только для развлекательных целей, а не для серьёзного использования. Возможно, это стандартные оговорки, но они несколько противоречат рекламе и маркетингу компании, ранее активно продвигавшей свои ИИ-сервисы среди пользователей, отметил ресурс Tom’s Hardware.

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

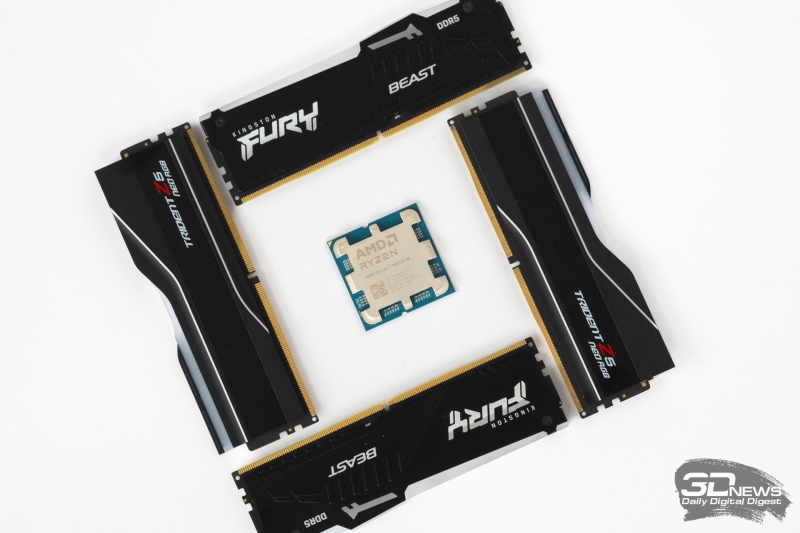

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

В октябре прошлого года Microsoft обновила «Условия использования Microsoft Copilot», в которых теперь указано, что большая языковая модель ИИ (LLM) предназначена только для развлекательных целей, и пользователи не должны использовать её для получения важных рекомендаций.

«Copilot предназначен только для развлекательных целей. Он может совершать ошибки и может работать не так, как задумано, — говорится в документе. — Не полагайтесь на Copilot в вопросах важных советов. Используйте Copilot на свой страх и риск».

Аналогичные предупреждения содержатся в правилах использования ИИ и у других компаний. Например, xAI предупреждает: «Искусственный интеллект быстро развивается и имеет вероятностный характер; поэтому иногда он может: а) приводить к результатам, содержащим “галлюцинации”; б) быть оскорбительным; в) неточно отражать реальных людей, места или факты; или г) быть неприемлемым, неуместным или иным образом не подходящим для вашей цели».

Несмотря на предупреждения, некоторые люди воспринимают советы ИИ как истину в последней инстанции — даже те, кто по роду службы должен понимать это лучше. Tom’s Hardware привёл пример сервисов Amazon: по сообщениям, сбои в работе AWS были вызваны ботом-программистом, который позволил инженерам решить проблему без должного контроля. Сам веб-сайт Amazon также пострадал из-за «изменений, внесённых с помощью генеративного ИИ».

Хотя генеративный ИИ является полезным инструментом и действительно может повысить производительность работы, следует помнить, что это всё ещё всего лишь инструмент, который не несёт ответственности за допущенные ошибки. Поэтому при его использовании следует соблюдать осторожность, всегда сомневаться в его результатах и перепроверять их, отмечает Tom’s Hardware.

Добавить комментарий