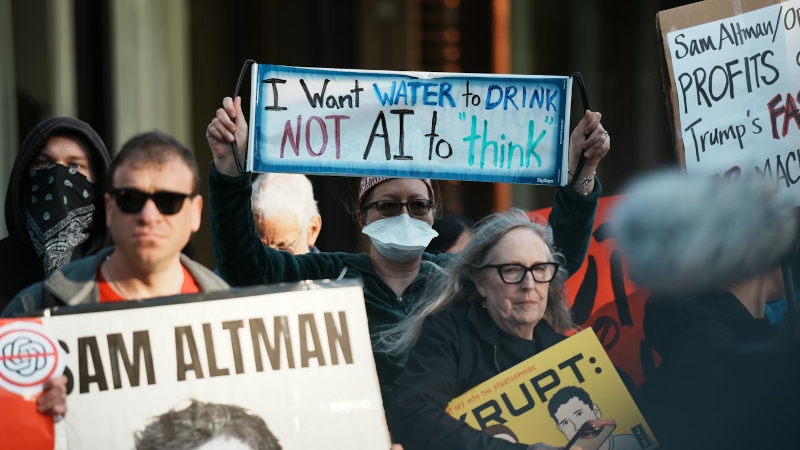

OpenAI вновь оказалась в центре скандала, связанного с вопросами доверия к руководству. Поводом стала новая публикация о главе компании Сэме Альтмане (Sam Altman), после которой обсуждение рисков ИИ сместилось от самой технологии к тем, кто принимает ключевые решения. В фокусе оказались старые претензии к откровенности Альтмана, новые свидетельства его бывших коллег и собственный доклад OpenAI о возможных тяжёлых последствиях широкого внедрения ИИ.

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Публикация Ронана Фэрроу (Ronan Farrow) и Эндрю Маранца (Andrew Marantz) в The New Yorker сводит претензии к Альтману к одному выводу: часть людей, работавших с ним, считает его уклончивым и ненадёжным. Один из бывших членов совета OpenAI формулирует это предельно резко: «Для него правда не является ограничением». Сам упрёк не нов. Осенью 2023 года совет директоров OpenAI уволил Альтмана, заявив, что он «не был неизменно откровенен в своих высказываниях и общении». Позднее Альтман вернулся на пост главы компании, а большинство его противников покинули OpenAI.

Разногласия с бывшими коллегами после этого не исчезли. Несколько ИИ-стартапов создали люди, прежде работавшие с Альтманом, а затем ставшие его оппонентами. Самый заметный пример — компания Anthropic, которой руководит бывший топ-менеджер OpenAI Дарио Амодеи (Dario Amodei). Его неприязнь к Альтману давно стала частью публичного конфликта между выходцами из OpenAI.

Новые трения, как утверждает пресса, затронули и действующее руководство компании. The Information пишет, что у Альтмана не складываются отношения с финансовым директором Сарой Фрайар (Sarah Friar). Для OpenAI, которая готовится к выходу на биржу в 2026 году, такой конфликт имеет прямое значение. По данным издания, Фрайар ранее в 2026 году говорила коллегам, что не считает компанию готовой к первичному размещением акций (IPO).

OpenAI оспорила сообщения о внутренних разногласиях. В ответ на публикацию The Information компания распространила совместное заявление Альтмана и Фрайар, в котором сказано, что оба в течение последнего года с лишним напрямую участвовали во всех значимых решениях по вычислительной инфраструктуре. Тем самым OpenAI попыталась опровергнуть вывод о том, что Фрайар была отстранена от обсуждения ключевых финансовых вопросов. Отдельно компания раскритиковала публикацию The New Yorker, заявив, что значительная часть текста пересказывает уже известные события через анонимные утверждения и выборочно подобранные свидетельства людей с явной заинтересованностью.

Спор о доверии к Альтману обострился в момент, когда сама OpenAI призвала обсуждать регулирование передовых ИИ-систем. В докладе Industrial Policy for the Intelligence Age: Ideas to Keep People First компания пишет, что ИИ способен принести значительные выгоды, но одновременно создаёт серьёзные риски. Среди них названы исчезновение рабочих мест и целых отраслей, злоупотребление технологией со стороны злоумышленников, выход ИИ из-под человеческого контроля, использование ИИ государствами и институтами в ущерб демократическим ценностям, а также усиление концентрации власти и богатства в руках корпораций.

OpenAI связывает эти риски с собственной исходной миссией. Компания напоминает, что в 2015 году Альтман и его сооснователи создали некоммерческую структуру именно для того, чтобы помогать сдерживать такие угрозы. Сегодня у OpenAI действует гибридная структура, сочетающая коммерческую и некоммерческую модели управления. В том же докладе компания предлагает и практические меры: изменить налоговые правила, чтобы увеличить сборы с крупных компаний и богатых людей и компенсировать возможное сокращение поступлений от налогов в фонд оплаты труда, если ИИ вытеснит с рынка большое число работников, а также ввести дополнительные налоги для компаний, заменяющих людей ИИ.

Добавить комментарий