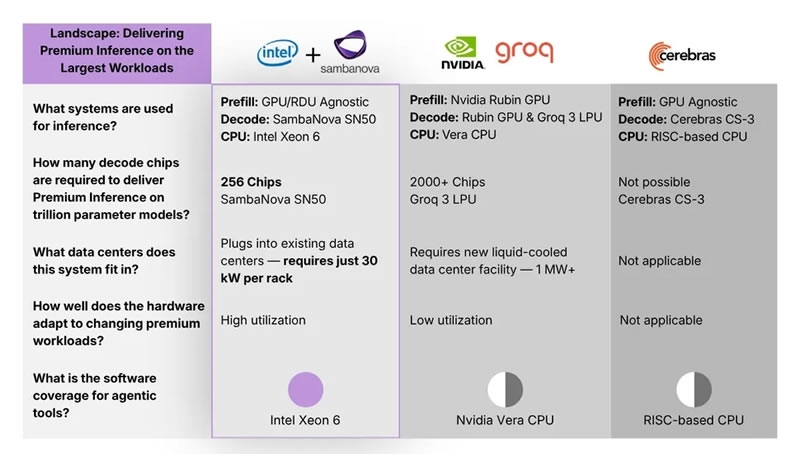

Компании Intel и SambaNova анонсировали готовую к производству гетерогенную архитектуру для ИИ-инференса, которая распределяет задачи между разными типами оборудования. Платформа использует графические процессоры для предварительной обработки, специализированные модули SambaNova для генерации токенов и процессоры Xeon 6 для управления агентскими задачами.

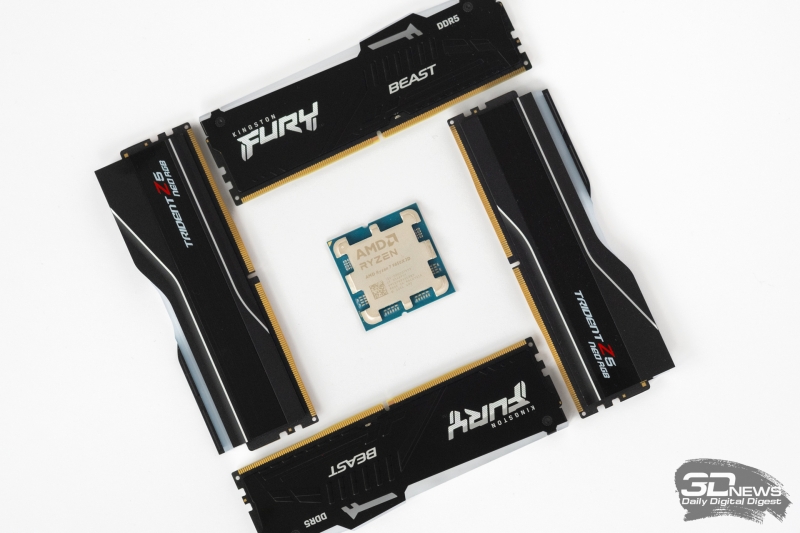

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

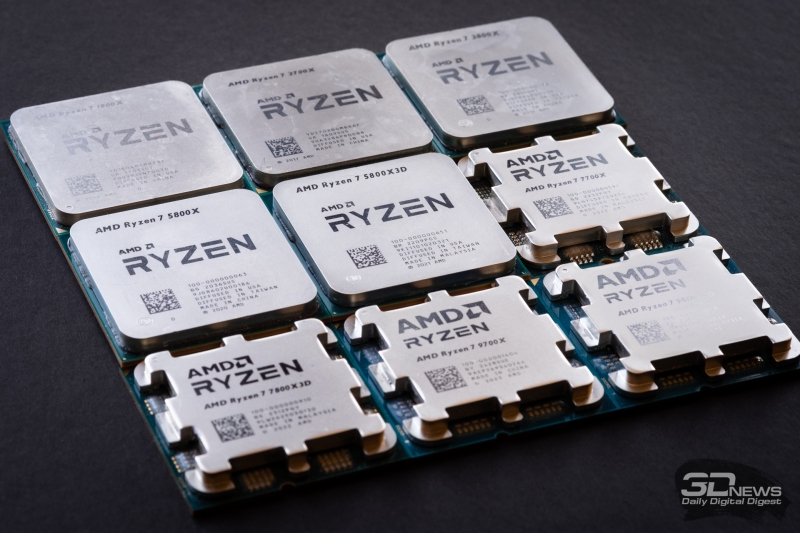

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

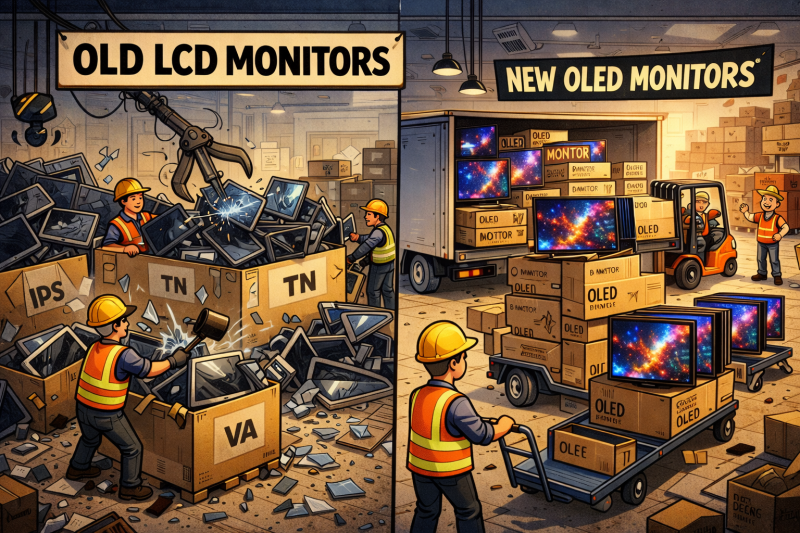

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Разработанная система разделяет процесс логического вывода на отдельные этапы, где каждый тип чипа выполняет свою специфическую функцию. Графические ускорители или ИИ-акселераторы занимаются первичной обработкой длинных запросов (ingest) и созданием кешей ключ-значение, в то время как реконфигурируемые блоки данных SN50 от SambaNova отвечают за декодирование. В свою очередь процессоры Intel Xeon 6 координируют распределение нагрузки и выполняют операции, связанные с ИИ-агентами, такие как компиляция кода и валидация результатов. Это позволит охватить максимально широкий спектр рабочих нагрузок и конкурировать с Nvidia и другими игроками рынка.

Такой подход к разделению prefill, decode и генерации токенов, как отмечает Tom’s Hardware, перекликается со стратегией Nvidia в её будущей платформе Rubin, где аналогичные функции должны были распределяться между чипами Rubin CPX и Rubin GPU. Однако ключевое отличие в том, что решение Nvidia пока не вышло на рынок, тогда как Intel и SambaNova смогут предложить готовую к внедрению архитектуру уже во второй половине 2026 года.

По внутренним оценкам SambaNova, процессоры Xeon 6 ускоряют компиляцию LLVM более чем на 50 % по сравнению с серверными чипами на архитектуре Arm. Кроме того, их производительность в задачах с векторными базами данных на 70 % превышает показатели конкурирующих x86-решений, таких как AMD EPYC. По словам представителей компаний, такой прирост эффективности достигается за счёт оптимизации взаимодействия между компонентами системы и позволяет существенно сократить циклы разработки кодирующих агентов и других ИИ-приложений полностью собственными силами.

Ключевым преимуществом новой архитектуры стала её полная совместимость с существующей инфраструктурой дата-центров, поддерживающих мощность до 30 кВт. Это позволяет предприятиям внедрять решение без необходимости масштабной модернизации систем охлаждения и энергоснабжения. Ожидается, что платформа станет доступна для корпоративных клиентов, облачных операторов и национальных государственных инициатив в области искусственного интеллекта во второй половине 2026 года.

Исполнительный вице-президент и генеральный директор группы центров обработки данных (DCG) Intel Кеворк Кечичян (Kevork Kechichian) отметил, что экосистема программного обеспечения дата-центров исторически построена на x86, что гарантирует, по его мнению, Xeon роль надёжного фундамента для будущих гетерогенных вычислений.

Добавить комментарий