На платформе Artificial Analysis опубликовали предназначенную для генерации видео модель искусственного интеллекта HappyHorse-1.0, которая со значительным отрывом обошла лидера в лице Seedance 2.0 от ByteDance.

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

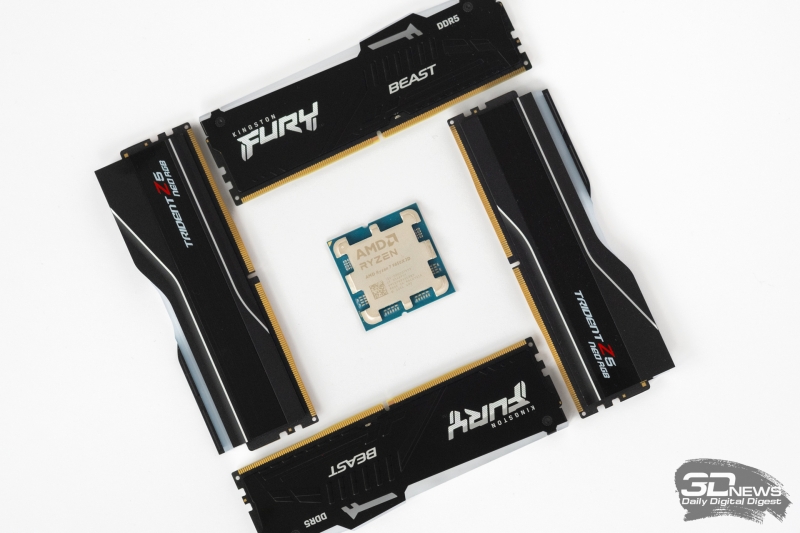

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

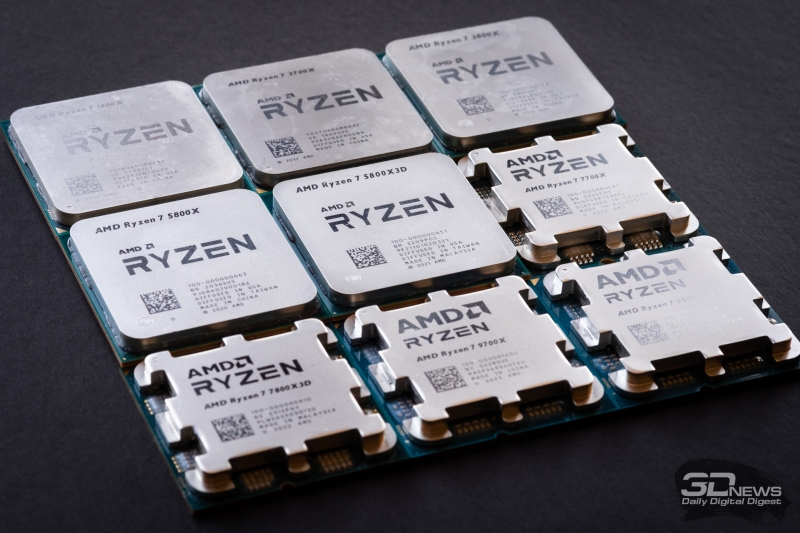

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

В категории генерации видео без звука по текстовому запросу HappyHorse-1.0 набрала рейтинг Elo 1357, опередив Seedance 2.0 на 84 балла; в задачах на анимацию статической картинки она показала Elo 1402, также выйдя на первое место. В генерации видео со звуком она оказалась второй, уступив Seedance 2.0 с 1215 баллами против 1220; а в анимации картинок снова оказалась первой с результатом 1160 против 1158 у прежнего лидера. Оторваться на 84 балла в этом рейтинге — это сильный результат, указывающий, что в слепом тестировании HappyHorse-1.0 оказывается лучше примерно в 62 % случаев.

Разработчиком HappyHorse-1.0 оказалась Future Life Lab при Taotian Group — это подразделение Alibaba отвечает за технологии электронной коммерции. Главой лаборатории является Чжан Ди (Zhang Di), прежде занимавший пост вице-президента Kuaishou и технического руководителя проекта Kling AI, ранее выпускавшего мощные генераторы видео. В конце 2025 года он начал работу в Taotian, и модель HappyHorse-1.0 стала первым проектом новой структуры. Примечательно, что у Alibaba уже был собственный ИИ-генератор видео Wan, который тоже оказался слабее нового проекта.

HappyHorse-1.0 представляет собой ИИ-модель на архитектуре 40-слойного трансформера с 15 млрд параметров, в котором данные генерируются диффузионным методом и обрабатываются единым потоком, включающим текст, изображения, видео и звук. Ресурсов ускорителя Nvidia H100 хватает для генерации 5-секундного клипа в разрешении 256p за 2 секунды; на генерацию 5-секундного ролика в 1080p уходят 38 секунд. Разработчики обещают в скором будущем выложить в открытом виде базовую модель HappyHorse-1.0, её уменьшенную дистиллированную версию, модуль повышения разрешения и код для запуска модели.

Добавить комментарий