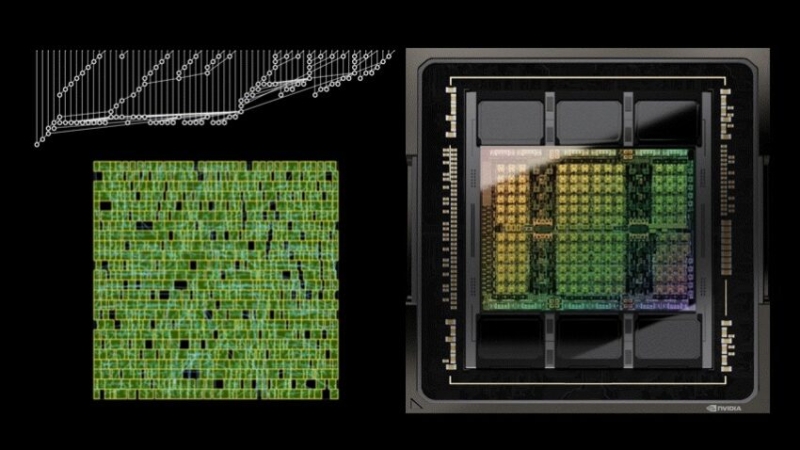

Nvidia активно использует искусственный интеллект на некоторых этапах внутреннего процесса проектирования своих чипов. Об этом в разговоре с главным научным сотрудником Google Джеффом Дином (Jeff Dean) в рамках конференции GTC рассказал главный научный сотрудник Nvidia Билл Далли (Bill Dally). По словам последнего, компания применяет ИИ для исследования проектных решений, работы со стандартной библиотекой ячеек, устранения ошибок и верификации. Далли добавил, что до полностью автоматизированного проектирования чипов ещё далеко.

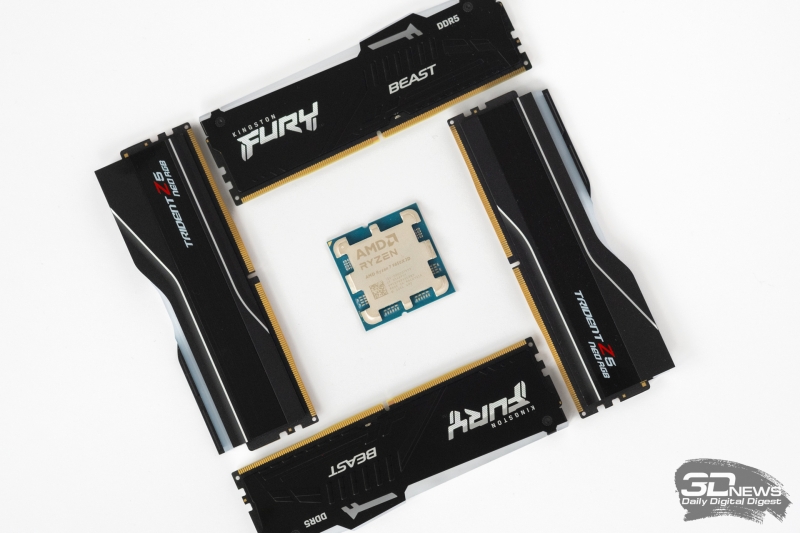

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

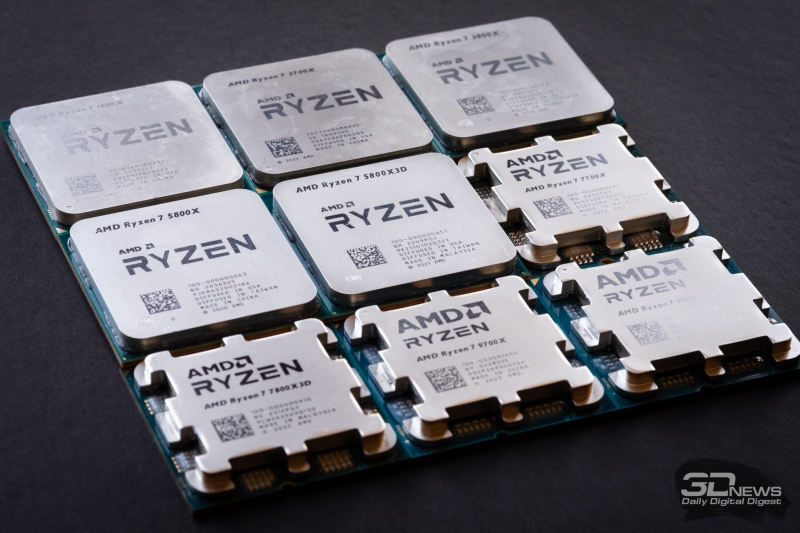

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Одним из примеров, которыми поделился Далли, является инструмент NB-Cell от Nvidia. По его словам, раньше на перенос стандартной библиотеки ячеек компании на новый полупроводниковый техпроцесс силами команды из восьми человек уходило около 10 месяцев. ИИ-инструмент на основе обучения с подкреплением теперь выполняет эту работу за одну ночь на одном графическом процессоре, а получаемые в результате ячейки по размеру, энергопотреблению и задержке не уступают разработкам, созданным людьми, а то и превосходят их.

«В процессе проектирования мы стараемся использовать ИИ везде, где только можно. Например, каждый раз, когда мы переходим на новый полупроводниковый техпроцесс, нам приходится переносить на него нашу стандартную библиотеку ячеек. В ней от 2500 до 3000 ячеек, и раньше для этого требовалась команда из восьми человек, которые работали над задачей около 10 месяцев, то есть на это уходило 80 человеко-месяцев. Затем мы разработали программу на основе обучения с подкреплением под названием NB-Cell. Думаю, сейчас у нас уже версия NB-Cell 2 или 3. Она справляется с задачей за одну ночь на одном графическом процессоре. Результаты по таким параметрам, как размер ячейки, рассеиваемая мощность и задержка, даже превосходят разработки, созданные людьми. Они соответствуют разработкам, созданным людьми, или превосходят их. Это огромный прирост производительности, и он устраняет препятствия на пути к переходу на новые техпроцессы, потому что теперь мы можем очень быстро переносить библиотеки ячеек», — Билл Далли, главный научный сотрудник Nvidia.

Далли также упомянул ещё один внутренний инструмент под названием Prefix RL, предназначенный для решения давно изученной проблемы размещения упреждающих элементов в цепи упреждающего переноса. По его словам, система генерирует схемы, которые «не смог бы придумать ни один человек», при этом улучшая ключевые показатели примерно на 20–30 % по сравнению с решениями, созданными людьми. Это важная деталь, поскольку она показывает, что Nvidia использует искусственный интеллект не только для экономии времени инженеров, но и для поиска решений, выходящих за рамки обычной человеческой интуиции.

В более широком смысле, по словам Далли, Nvidia использует внутренние языковые модели под названием Chip Nemo и Bug Nemo. Эти модели постоянно дорабатываются на основе собственных материалов Nvidia, в том числе RTL-кода и архитектурных документов для графических процессоров, разрабатывавшихся на протяжении многих лет. По его словам, одно из практических преимуществ заключается в том, что младшие инженеры могут обращаться к модели, а не постоянно спрашивать старших разработчиков, как работает тот или иной блок. Кроме того, система может обобщать отчёты об ошибках и помогать распределять их по нужным модулям или инженерам.

Добавить комментарий