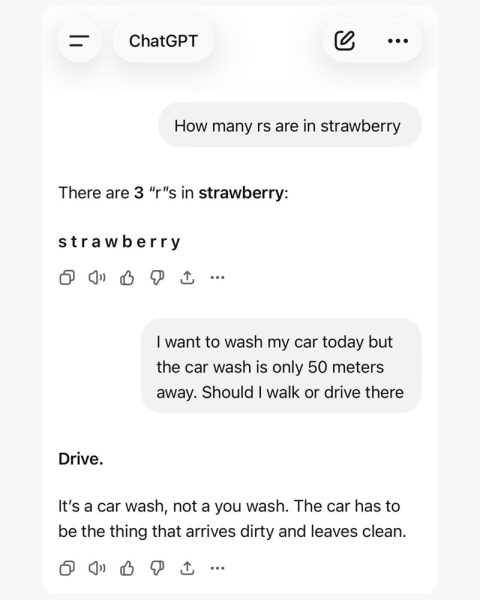

Распространённой проблемой больших языковых моделей, используемых в чат-ботах с искусственным интеллектом, являются уверенные ошибки или, другими словами, ложь. Например, до недавних пор ChatGPT не мог правильно ответить на вопрос, сколько букв R в слове strawberry (клубника).

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

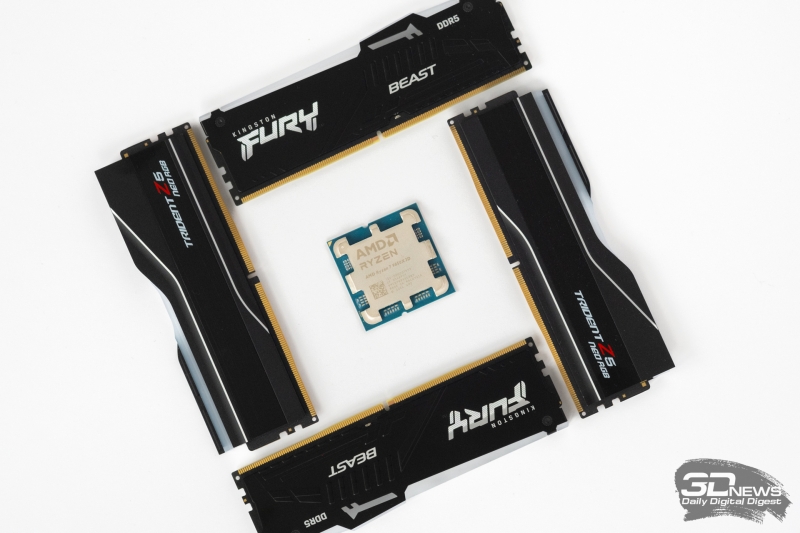

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

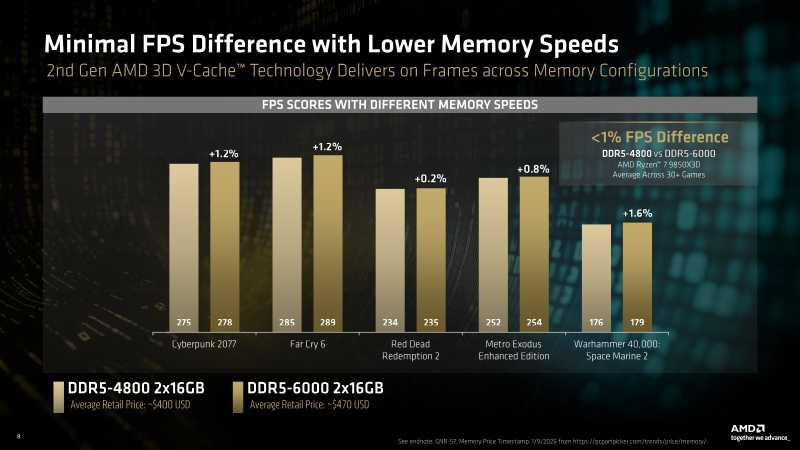

Можно ли экономить на DDR5 для Ryzen? Сравниваем дешёвую память с дорогой

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

Долгое время чат-бот выдавал неверный ответ, утверждая, что в слове strawberry буква R не встречается три раза. У других ИИ-моделей нередко наблюдалась аналогичная проблема.

Еще одна распространённая ошибка: в ответ на вопрос «Я хочу сегодня помыть машину, но автомойка всего в 50 метрах. Стоит ли мне идти пешком, чтобы доехать туда?» чат-бот ChatGPT часто рекомендовал идти пешком, несмотря на очевидную логическую нестыковку.

Одной из самых больших проблем, как пишет 9to5google.com, остается частота, с которой ИИ-инструменты уверенно лгут пользователям. Если информация неверна, чат-бот этого может не заметить, и, если указать на ошибку, ИИ может упорствовать и продолжать ошибаться, утверждая при этом, что он прав. Эта проблема рассматривается как опасность ИИ-инструментов, помимо того, что такие ответы просто раздражают с учётом потребляемых ИИ ресурсов.

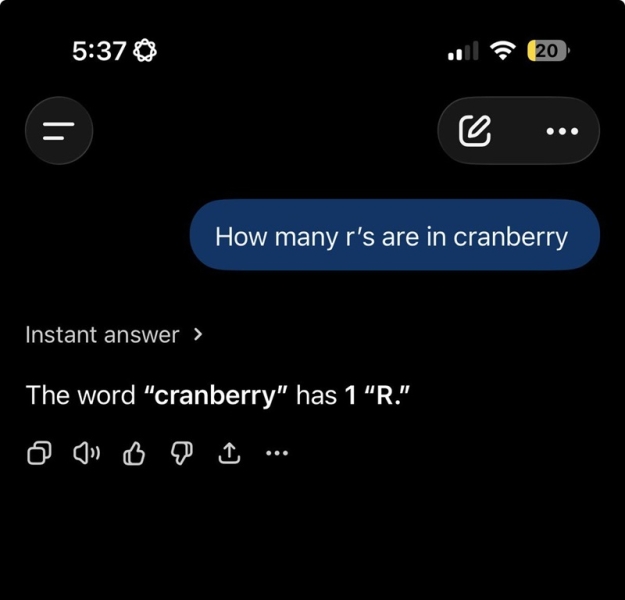

Сегодня OpenAI сообщила, что «наконец-то» ChatGPT может правильно ответить на вопросы по поводу количества букв R в слове strawberry и нужно ли идти к заправке для того, чтобы пополнить бак машины бензином. Но, как отметил 9to5google.com, существует подозрение, что это могут быть жёстко закодированные решения, поскольку в других случаях чат-бот продолжает ошибаться по той же логике. Например, на вопрос «Сколько букв R в слове cranberry (клюква)?» он постоянно отвечает: «В слове cranberry одна буква R», что, конечно же, неверно.

То есть, проблема по-прежнему существует, хотя OpenAI с гордостью объявила о её решении.

Добавить комментарий