OpenAI рассказала широкой аудитории о своей проблеме с гоблинами — к этому компанию подвиг материал на сайте Wired. Как выяснилось, разработчик систем искусственного интеллекта вынужден дополнительно инструктировать свои модели «никогда не говорить о гоблинах, гремлинах, енотах, троллях, ограх, голубях или других животных и существах», потому что эти модели в процессе обучения выработали такую «странную привычку».

Гид по выбору OLED-монитора в 2026 году: эволюция в деталях

Обзор Samsung Galaxy Z TriFold: тройной складной смартфон по цене квартиры в Воркуте

Обзор ноутбука HONOR MagicBook X16 2026: как раньше, только лучше

Компьютер месяца, спецвыпуск: эпоха отката, или Как дефицит чипов памяти влияет на выбор железа для игрового ПК

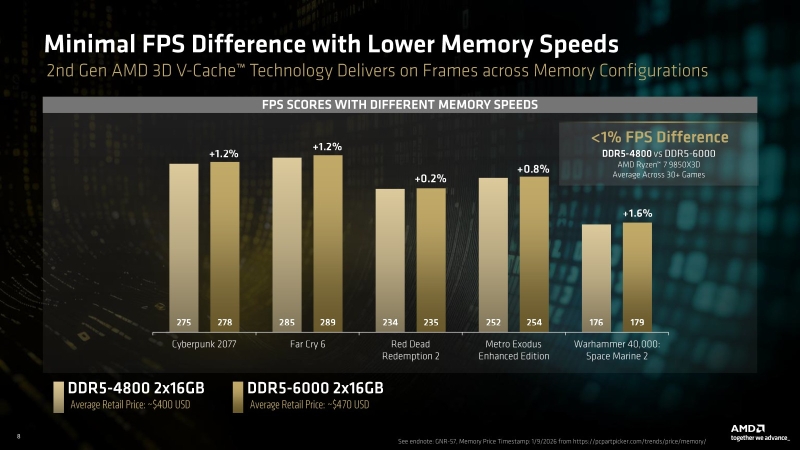

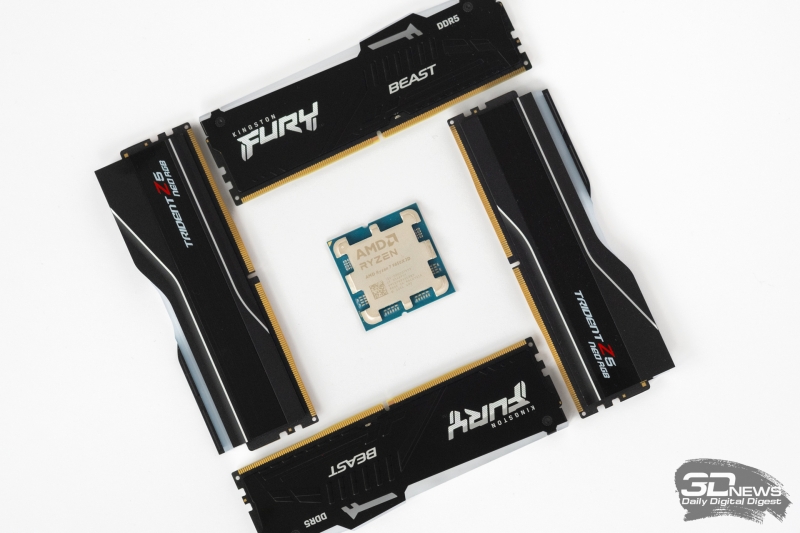

Можно ли экономить на DDR5 для Ryzen? Сравниваем дешёвую память с дорогой

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

Обзор Ryzen 7 9850X3D: три процента за двадцать баксов

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Ryzen и 16 Гбайт DDR5: как сэкономить на памяти так, чтобы не лишиться 15 % производительности

Компания обратила внимание на то, что ИИ стал подозрительно часто прибегать к метафорам с гоблинами и другими вымышленными существами с выходом модели GPT-5.1, особенно при подключении персонажа «Ботаник» (Nerdy). С каждым последующим выпуском модели проблема только усугублялась, пока не обнаружилось, что в процессе обучения с подкреплением эти причудливые метафоры сопровождались вознаграждением.

Вознаграждение производилось только при включении личности «Ботаника», но процесс обучения с подкреплением не гарантирует, что усвоенные механизмы поведения так и останутся привязанным к породившим их условиям. На последующих этапах этот стиль поведения может вознаграждаться и усиливаться и в других местах, особенно если эти результаты повторно используются в контролируемой тонкой настройке или в данных о предпочтениях, пояснил разработчик.

Упоминания гоблинов и гремлинов преимущественно исчезли марте, когда OpenAI отказалась от «Ботаника», но всплыли в сервисе программирования Codex с моделью GPT-5.5 — её обучение началось ещё до того, как компания обнаружила первопричину. Поэтому ей пришлось давать Codex дополнительные инструкции не упоминать мифологических существ. Впрочем, для тех, кому эта манера поведения нравится, OpenAI предложила код отмены этих инструкций.

Добавить комментарий