Компания Google анонсировала масштабное обновление поисковой системы, которое изменит формат ИИ-обзоров (AI Overviews). Теперь в ответах нейросети будут появляться прямые цитаты из публичных обсуждений на форумах, в соцсетях и блогах, включая Reddit, а также ссылки на материалы из платных новостных подписок пользователя.

Компьютер месяца — май 2026 года

Выбираем лучший игровой ноутбук до 100 000 рублей: сравнительное тестирование 7 интересных моделей

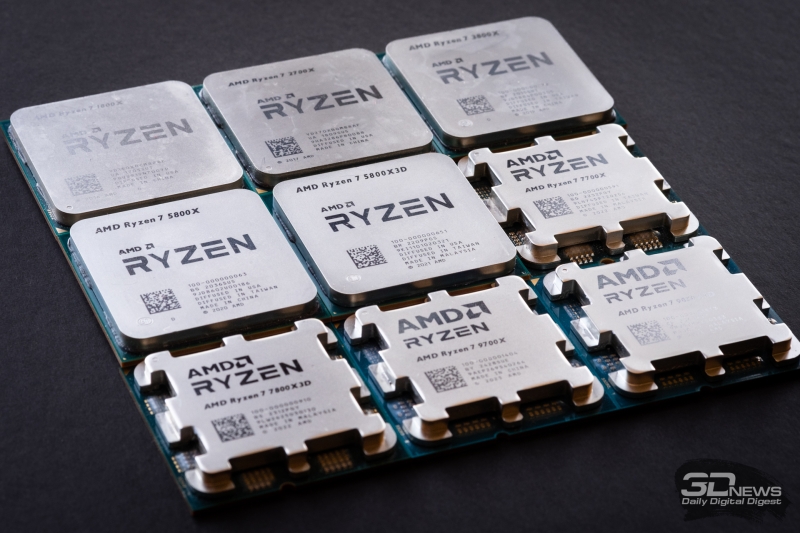

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

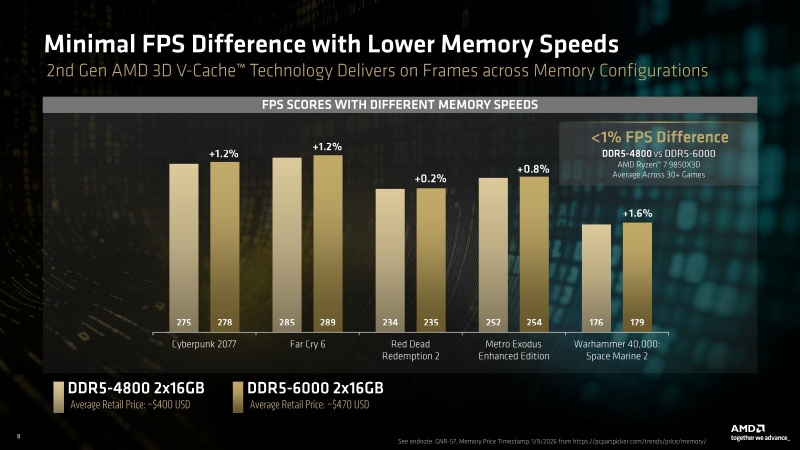

Можно ли экономить на DDR5 для Ryzen? Сравниваем дешёвую память с дорогой

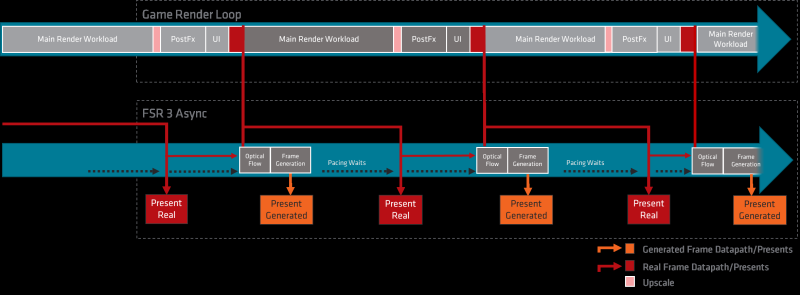

Больше кадров — больше лага: тестирование латентности с генерацией кадров DLSS и FSR

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

По заявлению компании, ответы искусственного интеллекта будут включать превью мнений из публичных онлайн-дискуссий и первоисточников, сопровождая их именами авторов или названиями сообществ и направлены на помощь пользователям в поиске советов и личных мнений, которые часто ищут, добавляя слово «Reddit» к своим запросам.

Когда Google впервые дополнила свой поиск ответами нейросести, то пользователи восприняли это неоднозначно, быстро обнаружив, что ИИ не распознаёт сарказм и ссылается на сомнительные источники. Например, в одном из случаев ИИ посоветовал съедать «один маленький камень в день», опираясь на публикацию сатирического издания The Onion, а в другом — предложил добавить в пиццу клей, используя пост с Reddit.

Несмотря на значительные улучшения ИИ-алгоритмов, проблема галлюцинаций остаётся актуальной для технологий, основанных на больших языковых моделях (LLM). Недавно газета The New York Times выявила, что ИИ-обзоры дают верные ответы в девяти случаях из десяти. Однако для поисковой системы, обрабатывающей триллионы запросов ежегодно, даже небольшой процент ошибок означает сотни тысяч неточных результатов каждую минуту, создавая по факту риски для пользователей, ищущих объективную информацию, особенно в чувствительных темах, где цена ошибки может быть высока.

Добавить комментарий