Универсальные ИИ-чат-боты и специализированные ИИ-модели для биологии облегчают проектирование токсинов, вирусов и пандемических патогенов, а с ними и нового биооружия. Серьёзность угрозы подтверждают опрошенные журналом Nature учёные и исследователи. Однако они расходятся во мнениях: одни требуют ограничить доступ к программам и обучающим данным, другие — ставить барьер на этапе синтеза ДНК. Часть исследователей надеется, что тот же ИИ поможет создать антидоты и противоядия.

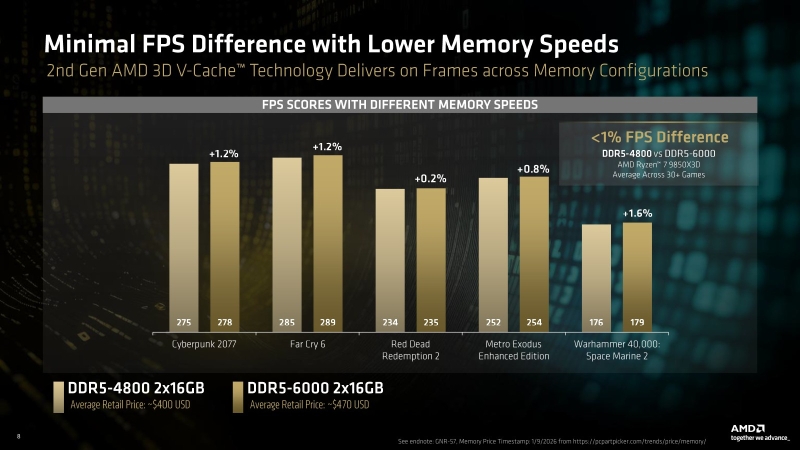

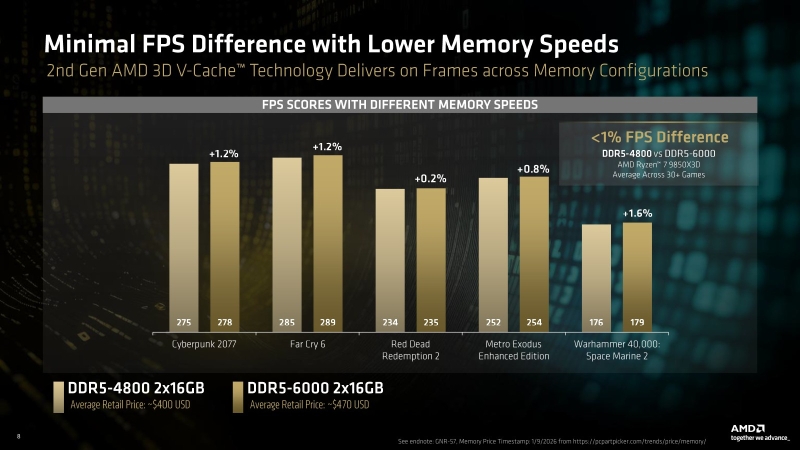

Можно ли экономить на DDR5 для Ryzen? Сравниваем дешёвую память с дорогой

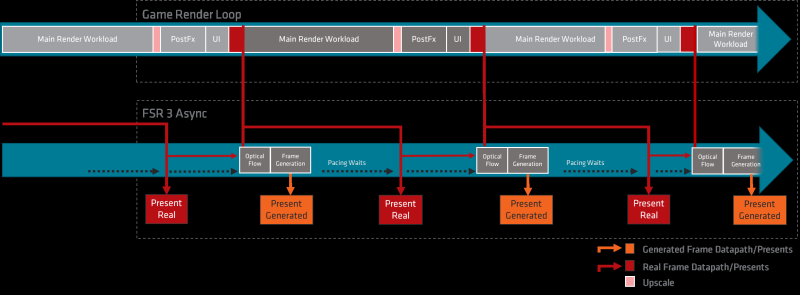

Больше кадров — больше лага: тестирование латентности с генерацией кадров DLSS и FSR

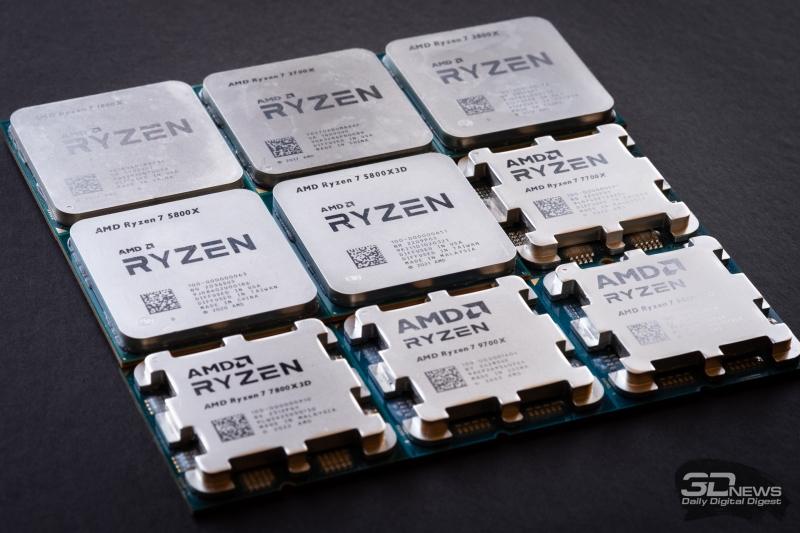

От Ryzen 7 1800X до Ryzen 7 9850X3D: девять лет эволюции AMD в одном тесте

Обзор Apple MacBook Neo: удивительно хороший ноутбук с процессором от iPhone

Компьютер месяца — май 2026 года

Тревожным сигналом стал разработанный в 2024 году китайскими учёными ИИ-инструмент для проектирования конотоксинов — белков из яда морских моллюсков-конусов, способных блокировать ионные каналы нервной системы и убивать человека. В письме в закрытую дискуссионную группу по ИИ и биотехнологиям, с которым ознакомился Nature, высокопоставленный сотрудник правительства США назвал работу возможным риском для биобезопасности — особенно потому, что инструмент построен на открытой языковой модели белков, разработанной американскими учёными. Соавтор статьи Сюэ Вэйвэй (Weiwei Xue) из Чунцинского университета возражает: работа нацелена на поиск лекарств, а переход от расчётов к созданию реальных молекул требует серьёзной экспертизы и оборудования.

«Теоретически — и именно это не даёт мне спать ночами — сейчас можно разработать токсины уровня рицина или других очень смертоносных агентов, которые будут практически необнаружимы», — говорит Мартин Пачеса (Martin Pacesa), структурный биолог из Цюрихского университета (UZH). Доклад Национальных академий наук, инженерии и медицины США (NASEM) за 2025 год добавляет трезвости: усилению пандемических патогенов мешают нехватка качественных данных и трудности с их лабораторным производством. Но создание дизайнерских токсинов уже доступно, признают эксперты, а Тимоти Дженкинс (Timothy Jenkins) из Технического университета Дании (DTU) предупреждает, что такой токсин будет трудно обнаружить, а применить его скорее могут против конкретного человека.

Главная защита, по мнению многих учёных, происходит на этапе синтеза ДНК: компании, изготавливающие ДНК, прогоняют каждый заказ через скрининговое ПО, ищущее следы известных токсинов и патогенных белков. Работа исследователей Microsoft под руководством Эрика Хорвица (Eric Horvitz), опубликованная в 2025 году, показала, что эту проверку можно обойти с помощью ИИ. Команда сгенерировала 76 000 синтетических гомологов — молекул с той же опасной функцией, что у известных токсинов и вирусных белков, но с другой ДНК-последовательностью, незнакомой скрининговым базам. Около четверти лучших образцов проскользнули мимо проверки в четырёх компаниях по синтезу ДНК, участвовавших в эксперименте, но после обновления ПО пропуск упал примерно до 3 %. Скрининг ДНК пока остаётся добровольным: указ президента США 2025 года толкает американских грантодателей к обязательным правилам, Европейский союз (ЕС), Великобритания и Новая Зеландия идут следом, но в большинстве стран требований нет. В Китае (более 30 % мировых заказов на синтез ДНК) скрининг рекомендован правительством, но обязательным пока не стал.

Встроенные защитные ограничения самих ИИ-моделей тоже обходятся. В исследовании SecureBio под руководством Сета Доноу (Seth Donoughe) почти 90 % участников сумели получить от универсальных больших языковых моделей (LLM) биологическую информацию высокого риска. Биоинженер Лэ Цун (Le Cong) из Стэнфорда с помощью универсального ИИ-агента обманом заставил геномную языковую модель Evo 2 сгенерировать новые версии белков коронавируса SARS-CoV-2 и ВИЧ-1 (HIV-1), хотя её не обучали на данных о вирусах, заражающих человека. Издание The New York Times ранее сообщало, что мужчина, арестованный в Индии по обвинению в подготовке производства рицина для теракта, спрашивал советы у ChatGPT.

Часть индустрии движется к ограниченному доступу. В апреле OpenAI анонсировала ИИ-систему для биологии — GPT-Rosalind: её получат только проверенные исследователи и организации, а получивших доступ пользователей будут отслеживать на признаки разработки биооружия. Коалиция за инновации в области готовности к эпидемиям (CEPI) готовит в Осло «платформу готовности к пандемиям», которая, скорее всего, будет доступна только проверенным пользователям. В докладе RAND Corporation за 2025 год была проведена оценка 57 биологических ИИ-инструментов и 23 % из них сочли высокорисковыми. Дэвид Бейкер (David Baker) из Вашингтонского университета (UW), лауреат Нобелевской премии по химии 2024 года за труды по дизайну белков и предсказанию их третичной структуры, настроен сдержанно: «Мы всегда исходили из того, что польза для мира значительно превышает опасности. Но по мере роста возможностей этот вопрос важно держать в поле зрения».

Защита тоже не отстаёт. Дженкинс совместно с НАТО разрабатывает масс-спектрометрический метод идентификации дизайнерских белков в подозрительных образцах, а на рынок биозащиты вышли частные компании: Red Queen Bio в Сан-Франциско и Valthos в Нью-Йорке привлекли инвестиции на $15 млн и $30 млн соответственно. Стоит признать, что биотехнологический ИИ — обоюдоостр: те же модели создают и угрозу, и защиту, и кто опередит — неясно. «Многие участки этой темы кажутся мне одновременно крайне неопределёнными и крайне срочными», — говорит Тесса Алексаньян (Tessa Alexanian) из Международной инициативы по биобезопасности для науки (IBBIS).

Добавить комментарий